巨浪:生成式的神话还能持续多久?(怪盗团新书首发)

互联网怪盗团的第三本原创著作《巨浪:生成式AI的史诗和现实》业已由电子工业出版社出版并且在各大图书渠道上架了。正好遇到美国科技股连续两天暴跌、生成式AI概念短期可能见顶的时候,算是十分凑巧了。在此我想表达一个自己对生成式AI的基本观点:在长期,它必将彻底改变人类社会的形态,乃至构成第四次工业革命的基础;在短期,它可能被高估了,尤其是被资本市场高估。

前者与后者互不妨碍,我们都既生活在短期、也生活在长期,所谓长期就是由一个又一个短期连续组成的。

半年多以前,当出版社编辑提议我撰写一部关于生成式AI的书时,我一开始不太感冒:市面上这样的文章、著作已经很多了,没有必要再锦上添花。然而,我的态度终究还是改变了,因为通过与几位在互联网大厂从事AI研发的朋友交流,我意识到了下面的事实:

国内对生成式AI产业的理解,很大程度上是割裂的。技术开发者、管理者、投资人和分析师,各自看到了生成式AI的一部分,却缺乏足够的交流。至于圈外人士,要想看清产业链的整个图景,就更是难上加难了。

生成式AI涉及相当复杂的技术细节。市面上大部分关于生成式AI的产业研究和普及读物,要么过度纠缠于技术,导致非技术人员看不懂;要么基本不讨论技术,导致失去立足点。找到平衡点是至关重要的。

生成式AI的技术进步太快了,当人们还沉浸在Sora的震撼中时,巨浪:生成式的神话还能持续多久?(怪盗团新书首发)GPT-5的公测已经提上了议事日程,更不用说飞速进化的开源大模型了。无论是专业还是非专业人士,都容易沉浸在浩如烟海的新信息当中,找不到焦点。

因此,我决定写一本与众不同的关于生成式AI的书。首先,它应该对AI产业和AI技术过去多年的发展脉络做一个总结,以高屋建瓴的视角分析事物的全貌。其次,它应该深入浅出地讨论AI尤其是生成式AI的关键技术问题,但不应沉溺于这些问题。再次,它应该既涉及欧美最先进的生成式AI产业,也涉及中国在追赶中的生成式AI产业。最后,它应该脱离资本市场的短期视角,尽量讨论一些基本的、长远的问题,例如生成式AI到底要如何改造传统产业。

要针对生成式AI话题写一本有价值的、站得住脚的书并不容易。幸运的是,我在互联网和科技行业拥有许多值得信任的朋友。我一直认为,学习一件新鲜事物最好的方法,就是先向信得过的朋友咨询,以他们的意见为立足点。在本书结尾,我列出了给予我巨大帮助的一些专业人士的名字。除此之外,还参考了生成式AI产业链的主要公司,包括英伟达、台积电、微软、谷歌、亚马逊、苹果、AMD……等等的财报和电话会议纪要。虽然本书只涉及少量技术问题,但仍然参考了几篇比较重要的AI技术论文,在后记中也一并致谢。

本书的截稿日期是2024年4-5月。在此之后,生成式AI行业又发生了许多巨大变化,例如LLaMA-3发布、快手可灵发布、国产大模型价格战、伊利亚离开OpenAI,等等等等。幸运的是,本书的主要基调没有过时,仍然是站得住脚的。如果读者有需要,明年或许会进行一定程度的增补,以体现行业的新进展。

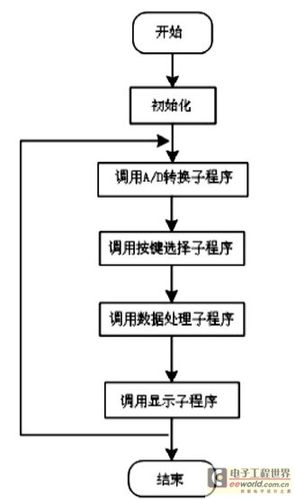

本书目录如下:

序生成式AI的突然降临

第一章AI之春:一部正在进行的史诗

从“深蓝”到AlphaGo:两种截然相反理念的斗争

李飞飞与ImageNet:人工智能革命的最初“训练场”

神经网络与深度学习:“AI之春”的技术基础

如日中天的谷歌AI帝国及其崩溃的预兆

第二章OpenAI的崛起历程与统治之道

为什么“自然语言处理”如此重要

不疯魔,不成活:OpenAI以偏执狂的方式击败谷歌

OpenAI内讧:“圣殿”之中究竟发生了什么

谷歌何以无法对OpenAI进行有效的反击

第三章全球总动员:白热化的生成式AI战局

AI大模型的竞争格局:独角兽vs巨头,开源vs闭源

岔路仍然很多:悬而未决的大模型技术问题

科技巨头的困局:是自研、合作,还是拥抱开源生态

应用战场:微软一马当先,但一切才刚刚开始

第四章算力战争:争夺第四次工业革命最重要的资源

英伟达:偶然性与必然性结合的传奇

台积电:难以逾越的全球芯片供应瓶颈

全球科技巨头的AI算力争夺战

关于AI算力的若干神话与现实

第五章生成式AI在中国的现状与未来

国产大模型现状:纷乱复杂的“2 N”格局

国内AIGC应用:希望与困惑

面对AIGC浪潮:矛盾的中国资本市场

“同”与“不同”:AIGC浪潮与当年的互联网浪潮在中国

第六章展望未来:AIGC对人类社会的改变

控制组织规模的重要性:从“人月神话”说起

“咒语创业”时代:当《哈利·波特》的场景成为现实

“AI霸权”的兴起与专业白领阶层的衰落

赡养人类?“智能体”全面普及之后的社会

附录主要参考及学习资料

以下段落摘自本书第二章第一节“为什么‘自然语言处理’如此重要”,有删减。欢迎大家多提宝贵意见!

伟大的计算机科学家、哲学家、逻辑学家阿兰·图灵(AlanTuring)于1941年发表了第一篇关于人工智能的论文;很遗憾,其全文现在已经遗失。1950年,图灵发表了另一篇论文,提出了“图灵测试”的概念。从那以后,“人工智能”(AI)这个概念经历了无数次扩张和演化,外延变得模糊不清。什么都可以是AI,没人说得清AI到底是什么。

在玩游戏的时候,我们会说“AI太强了”,意思是“由电脑控制的敌人太聪明了”;在刷短视频的时候,我们会说“AI怎么这么奇怪”,意思是“平台的推荐算法不符合我的口味”;在使用扫地机器人的时候,我们也会说“AI调教的不太好”,意思是“扫地机器人内置程序无法很好地识别我家的地貌”。在日常语境下,一切具备自动化和智能化属性的计算机程序,均会被我们归入AI的行列,AI这个词因此失去了意义。

不管外行人怎么看待AI,在人工智能专业人士的心目中,存在一颗“皇冠上的明珠”,大家梦寐以求的彼岸宝藏:通用人工智能

(AGI,ArtificialGeneralIntelligence)

。这个概念最早在1997年被学术界提出,当时还是所谓“AI寒冬期”。根据谷歌DeepMind的定义,通用人工智能应该同时在多个领域里展现出与人类相当或者强于人类的认知能力。这样的AGI很容易让人想到阿西莫夫科幻小说《我,机器人》当中的智能机器人。

游戏中用来控制敌人的程序,短视频平台的算法推荐程序,以及扫地机器人的内置程序,都只适用于某个特定的、狭窄的领域。就算在这个特定领域里,它们也不一定具备强于人类的认知能力,例如扫地机器人对室内空间和地貌的认知水平肯定比不上熟练的保洁阿姨。它们与通用人工智能相去甚远。

迈向通用人工智能,路在何方?没有人知道,因为那是人类从未涉足的领域。在2015年离开谷歌之后,伊利亚·苏茨克维与山姆·奥特曼合作成立了OpenAI,其目的从一开始就很清晰:为了早日实现AGI而努力。OpenAI设立了三个主攻方向,代表了通向AGI的三个可能路径:

第一是实体机器人。人类生活在物理世界里,每天跟海量的物理实体打交道,婴儿在学会说话之前就学会了爬行(有的还先学会了走路)。OpenAI开发了一个机器人系统Dactyl,其最著名的成果是操纵一个机器手臂玩魔方;到了2019年,Dactyl已经具备了复原三阶魔方的能力。就在同一时期,OpenAI还开发了名为RoboSumo的虚拟场景,用于模拟现实世界的地形、气候、物体关系,虚拟机器人可以在这里学习如何应对复杂的物理世界。

第二是玩游戏。虽然千千万万的家长很讨厌孩子玩游戏,但不可否认,游戏是人类的天性,而电子游戏是游戏艺术的最高形式。深度学习的三种主要方式是监督学习、强化学习和无监督学习,而游戏无疑是高效的强化学习方式:打怪升级、过关、拿高分,对模型而言都是很好的外部强化。OpenAI用于训练AI的游戏,既包括雅达利(Atari)等上古游戏主机上的简单游戏,也包括DoTA2这样的复杂游戏。附带说一句,OpenAI对DoTA2的训练效果不佳,引发过观众的群嘲。

2019年,百度贴吧网友的预言:“OpenAI快倒闭了”,因为其DoTA2电竞AI表现不佳

第三是自然语言。我们每个人每天都生活在语言文字的包围中。哪怕是独居的、远离社会的人,也不可能不阅读各种文本,以及通过电视、电话和互联网媒介接收各种语音信息。婴儿在学会最基本的肢体动作之后,就会开始牙牙学语。事实证明,自然语言是OpenAI下注最成功的道路,关于这一点,后续章节将会展开叙述。

OpenAI押注的上述三个方向,恰好也是谷歌大力押注的方向:在机器人领域,GoogleBrain的技术研发成果十分丰厚,谷歌收购过无数个机器人开发团队,还在2019年推出了专门为机器人开发服务的云平台。在游戏领域,DeepMind在围棋、《星际争霸2》上取得的成果有目共睹。在自然语言领域,谷歌提出的Transformer技术路线,以及在此基础上推出的BERT大语言模型,直到2021年都是毫无争议的领先者。其实这也不是巧合,因为谷歌会对所有可能通向AGI的技术路线都押下重注,与其说它与OpenAI“英雄所见略同”,倒不如说前者的资源过于雄厚,完全覆盖了后者的领域。

从事后诸葛亮的角度看,自然语言处理(NLP,NeutralLanguageProcessing)成为了对世界影响最大的突破口,

也很有可能是通向AGI的正确路径——对于这一点,有些人还有争议,但主流意见是认同的。为什么?这个世界上可以被认识、被理解的事物浩如烟海,人类的语言文字固然很重要,但是到底重要到什么地步?与前文提到过的图像识别、实体机器人以及玩游戏相比,自然语言处理究竟有多“特殊”?这个问题看似简单,实则十分复杂。

从实用主义的角度讲,人类互相沟通的主要方式是语言,能够理解自然语言的AI更容易跟人沟通。人们希望AI帮助处理的日常事务,有一大部分都是语言文字处理事务。即便是其他类型的AI,若能具备一定的自然语言能力,也会大幅提升人类的使用体验。想象一下,当你家的扫地机器人能够灵敏地辨认你的语音指示并以语音回答时,你应该会眼睛一亮。ChatGPT发布之后引起的铺天盖地的关注,充分说明了人类对于“能熟练使用人类语言的AI”有多么期待。然而,自然语言处理之所以成为人类向AGI突破的主阵地,除了实用角度之外,还有更深层次的原因。

看过《封神榜》的读者,应该还记得商朝忠臣比干的故事:妲己借口为自己治病,要剖开比干的胸膛,取出“七窍玲珑心”。被摘心后的比干,面色惨白,照常骑着马离开朝歌王宫。在朝歌的市场里,他遇见了一个妇人(据说是妲己的同伙)在叫卖无心菜。比干停下来问她:“人无心如何?”妇人回答:“人无心即死。”比干随即大叫一声,从马上摔下来,死了。

小时候我第一次读到这个故事时很疑惑:为什么比干被摘心了没事,听到“人无心即死”就死了?相信很多人有同样的疑惑。其实,这是世界各民族神话传说中经常出现的一种设定:语言是有魔力的,世界的真相可以由语言“道破”。

死去多年的人可能以为自己还活着,直到被人道破“你其实早就死了”。在希腊古典哲学里,存在名为“逻各斯”(Logos)的概念:它是世界的一般规律、指导万物变化的隐秘智慧,在本质上是一种语言,中文有时候会翻译为“道”。《新约·约翰福音》描述上帝创造世界的过程,第一句话就是“太初有道”,即上帝是通过神圣的语言创造世界的。

无论世界的本质是不是语言,人类认识事物的方式都根植于语言。实验显示,一门语言的常用语序,例如“主谓宾”或“宾主谓”,往往会影响其使用者看待事物的方式:前者可能倾向于优先关注“主语”,后者可能倾向于优先关注“宾语”。语言中的各种各样的词汇,构成了人类脑海中的“分类系统”,在一定程度上决定了他们如何看待世界。语言本身是由人类文化塑造的,而语言反过来又塑造了人类文化。当我们陷入沉思的时候,我们往往会在脑海中用自己熟悉的语言不停地“默念”,思考的过程就是用语言梳理周围环境的过程。

2015年,澳大利亚墨尔本大学的两位语言学家对澳大利亚西北海岸的一小群原住民的母语穆林帕特哈语(Murrinh-Patha)进行了深入研究。这是一种词序自由、主谓宾可以任意组合的语言。语言学家要求原住民观看一系列图片,然后用穆林帕特哈语讲述图片里描述了什么。结果很有趣:被试者的目光会在图片里的各个对象之间飞快地移动,试图厘清它们之间的关系,这个过程往往会在几百毫秒内完成!这可能是因为他们的语言没有固定的词序,所以他们必须先对图片形成整体认识,然后在脑海中组织语言。相比之下,母语为英语等“主谓宾”语言的被试者,一般倾向于先看“动作发出对象”(主语),再看“动作接受对象”(宾语)。在某种意义上,这些原住民的思维整体性更强。

20世纪最伟大的哲学家之一路德维希·维特根斯坦(LudwigWittgenstein)有一句颇具争议的名言:“哲学剩下的任务只是语言分析。”

这句话包含两层含义:首先,人类进步的历史就是哲学领地缩小的历史,在人类知识体系高度发展的情况下,哲学的研究范围在不停地被其他学科侵占,认识世界变成了自然科学的使命,认识人类变成了社会科学的使命;留给哲学的地盘只剩下语言了。

其次,语言分析可以为哲学的许多传统问题提出解药。例如,客观世界真实存在吗?除了我以外的其他人具备自我意识吗?我们如何确切地理解其他人的感觉?维特根斯坦认为,无论对外部的客观世界,还是内心的主观世界,我们都是通过语言认识的;语言带有公共性,不存在只有自己能理解、别人不能理解的“私人语言”。而且语言本身就是一种行动。比方说,我们会用语言去祝福自己亲爱的人,去诅咒自己的敌人,去呼唤朋友一起玩耍。那种认为语言只代表内心感受、与行动对立的观点,是肤浅的、不值一驳的。认识世界的正确方式不是搞“缸中之脑”“哲学僵尸”这样的哲学实验,而是从语言分析入手!

从上至下第二排右三为中学时代的维特根斯坦;第一排右一为他的同学阿道夫·希特勒,1933-1945年任德国总理

在其最重要的著作之一《逻辑哲学论》当中,维特根斯坦提出:世界是一切事实的总和,而语言是一切命题的总和;命题是事实的“图像”,所以语言就是世界的“图像”。语言的边界就是世界的边界,那些“不可言说”的东西,就是我们无法认识的。不过,维特根斯坦晚年的思想又有了大转向,开始批判自己早年对语言的看法(但不是完全推翻)。无论如何,他对“语言与世界的关系”的描述,深刻影响了一代又一代的哲学家、语言学家、心理学家。当代学术界的主流观点是:语言不仅是人类互相沟通的工具,也是人类认知和思考的工具。要学习人类的思维方式,语言就是最好的切入点!

因此,我们可以理解,为何自然语言处理成为了人工智能界“显学中的显学”,以及为什么大语言模型具备如此惊人的效率和创造力。通过实体机器人去认识世界的物理规律,这当然很好,但并非人类思维方式的支点;通过下围棋、玩游戏去提高自己的认知水平,这也非常好,但也不是人类思维方式的支点;学习并预测蛋白质的结构,那是非常有用的,但与人类思维方式的距离有点远。只有当神经网络模型熟练掌握了人类语言、能够与人类以自然语言无缝沟通时,它才真正掌握了人类的思维方式,也就掌握了人类认知范围内的“世界”。

无论当年OpenAI和GoogleBrain的科学家们有没有读过维特根斯坦,他们应该早已理解自然语言对人类思维的意义,因为他们的日常工作之一就是语言学、心理学、认知科学研究者打交道。在深度学习革命以后,人工智能变成了一个多学科交叉的研究领域,数理模型和代码只是基础设施,不能离开其他学科孤立发展。自从2017年Transformer模型发布之后,谷歌在自然语言处理方面投入的资源与日俱增,大语言模型就算不是谷歌AI帝国的核心,至少也是核心之一。在OpenAI那边也是如此,尤其是在2019年接受微软投资之后,大语言模型基本成为了一切希望所在。

在大语言模型方向上,谷歌与OpenAI的技术路线其实高度重合,仅在极少数问题上存在不同观点——这极少数问题正是一切的关键所在。我们知道,人类与黑猩猩的DNA有96%的相似性,但是前者建立了辉煌灿烂的文明,后者却只能在热带雨林和动物园里吃果实和树叶。下面就让我们看看二者的技术分歧究竟在哪里,以及这些分歧如何决定了竞争的胜负。

(由伊利亚·苏茨克维领衔的OpenAI研究团队以不可思议的偏执方式击败了谷歌,打赢了几乎毫无胜算的战役,将生成式AI从涓涓细流变成巨浪,直到他戏剧性地在一场宫廷政变中失败并离开OpenAI为止。对于这一点,相信大部分人略有耳闻,本书的第二章及第三章的一部分集中讨论了这些话题。)